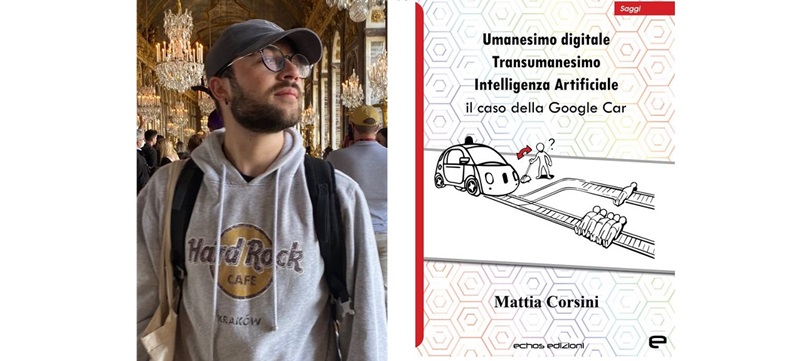

Mattia Corsini, 23enne nichelinese, è un giovane laureato in filosofia. Con la casa editrice Echos ha di recente pubblicato un libro che si intitola “Umanesimo digitale - Transumanesimo – Intelligenza Artificiale”. Sottotitolo: “Il caso della Google Car”.

Ora qualcuno si chiederà: cosa c’entra un “filosofo” con l’auto a guida autonoma?

Diciamo subito che c’entra, perché Mattia Corsini, dopo la laurea a Torino e un periodo di studio presso la Vrije Universiteit di Amsterdam, sta seguendo un master in Filosofia del Digitale e Intelligenza Artificiale a Udine.

Dunque, dottor Corsini, parliamo di transumanesimo e di umanesimo digitale. Come si può spiegare in parole semplici questi termini?

“Come in ogni rivoluzione scientifica, che è allo stesso tempo culturale e sociale, il mondo si divide in due orientamenti estremisti: da una parte troviamo coloro che sostengono ciecamente il cambiamento in questione, inteso come un progresso a cui non deve essere messo il cosiddetto ‘bastone tra le ruote’. Dall’altra parte c’è chi ripone una paura verso queste innovazioni, rifiutandole aprioristicamente. Le due etichette presenti nel titolo del libro rappresentano questa dicotomia all’interno della rivoluzione a cui stiamo assistendo con l’avvento dell’intelligenza artificiale. L’orientamento positivistico, che non ha la minima intenzione di porre limiti o freni, coincide con il termine “transumanesimo”. Questo termine indica la corrente di pensiero, sostenuta da studiosi, come ad esempio Nick Bostrom, per cui l’intelligenza artificiale riuscirà a rimpiazzare completamente quella umana, esplicandone meglio i compiti e le funzioni. Ossia non è più possibile considerare l’essere umano nel senso tradizionale: deve essere inteso come essere post-umano, totalmente in simbiosi con queste nuove entità tecnologiche.

Il termine “umanesimo digitale”, al contrario, rappresenta la posizione di chi sostiene che questo nuovo tipo di intelligenza non sarà mai in grado di replicare quella propria dell’uomo. Ci sono campi in cui quest’ultimo conserverà la propria unicità, ad esempio in quello morale.

Come viene affermato da uno dei maggiori esponenti di tale visione, Nida-Rümelin, l’essere umano, a causa della libertà che lo contraddistingue, è in grado di essere un agente morale, mentre le macchine autonome no. Ma siamo sicuri che le cose stiano proprio così?”

… E quindi adesso veniamo all’auto, alla Google Car che è diventata un “caso”. In pratica cosa è successo?

“Correva l’anno 2014 e il mondo si è trovato di fronte a un cambiamento epocale: il primo modello di self-driving car. Ci troviamo in California, dove Google ha deciso di mettere alla prova la sua nuova invenzione facendole percorrere in totale di circa 300.000 km su strade statali, in città con il traffico, ma anche su percorsi in montagna. Si sceglie la destinazione, si schiaccia un pulsante e via. Di primo acchito ciò rappresenta una fantastica opportunità, in quanto potenzialmente rimuove la principale causa di incidenti stradali, ossia l’errore umano. Intanto però bisogna vedere come la convivenza tra veicoli a guida autonoma e non possa risolversi pacificamente, senza portare a situazioni quanto meno bizzarre. Come quella avvenuta l’anno scorso a San Francisco dove un poliziotto ha fermato un veicolo con i fari spenti ad un posto di blocco, accorgendosi, successivamente, che non era presente alcun guidatore all’interno. È chiaro, dunque, che il lavoro da fare è tanto. Come è possibile che un veicolo dotato di tali superpoteri possa commettere un errore così macroscopico? È se questi errori vengono commessi in situazioni dove una determinata scelta va ad impattare con la vita umana delle persone?

Allora, forse, le cose non sono così perfette come sembrano e i grandi avanzamenti tecnologici necessitano anche di un compagno di viaggio come quello della ricerca filosofica”.

Se un’auto a guida automatica provoca un incidente di chi è la responsabilità legale? E di chi è quella morale?

“Ritengo che questi due tipi di responsabilità non siano così distinti, come solitamente tendiamo a fare. È necessaria un’azione congiunta sia a livello individuale sia a livello collettivo. La componente individuale dovrà consistere in una maggiore consapevolezza degli aspetti etici e di conseguenza in un uso responsabile, ma è richiesta anche una maggiore attenzione da parte dei programmatori dei software. L’aspetto collettivo riguarda il ruolo normativo tradizionalmente esercitato dallo Stato. La dimensione globale di queste tecnologie dovrà sempre di più assumere una regolamentazione a livello internazionale”.

Riusciremo a trovare un punto di equilibrio con la tecnologia o ne diventeremo schiavi?

“Aristotele, nella sua Etica Nicomachea, diceva che la virtù sta nel mezzo. Una frase semplice, semplicissima se vogliamo, ma con un forte messaggio: l’essere umano, se vuole veramente essere virtuoso e dunque agire in modo retto di fronte ai problemi che la realtà gli pone, deve cercare di evitare gli estremismi e mantenere un atteggiamento critico. Questo è l’unica strada che gli permette di poter usufruire dei benefici del mondo nel quale vive, riducendo, al contempo, i pericoli derivanti da un utilizzo smisurato e incontrollato.

Tutti noi in qualche modo ricerchiamo questo equilibrio, sia quando abbiamo a che fare con questioni complesse come il rapporto tra lavoro e famiglia sia per attività più circoscritte, ad esempio, per decidere se giocare ai videogiochi h 24 o fumare due pacchetti di sigarette al giorno.

Le tecnologie emergenti dotate di Intelligenza Artificiale non esulano da quanto appena sostenuto e, anche se i pericoli sembrano meno evidenti, se osservati da vicino, possono portare a conseguenze gravi. Se ci affidiamo ciecamente a questi nuovi strumenti, nel futuro prossimo potremmo leggere sempre più notizie dove una persona viene rifiutata sul lavoro o in altri ambiti della vita sociale in quanto un algoritmo ha effettuato questo tipo di decisione. Non possiamo più considerare questi strumenti tecnologici come meri mezzi. Per il ruolo che giocano nella società occorre considerarli come entità in grado di agire moralmente, nel bene e nel male. Ecco perché la filosofia può aiutarci a comprendere queste problematiche e cercare di porre rimedio”.

M.C.

È possibile trovare il libro di Mattia Corsini nelle principali librerie on line oppure presso la Libreria “Il Cammello”, via Stupinigi 4/piazza Di Vittorio - Nichelino